Накануне Европол заявил, что большие языковые модели на базе искусственного интеллекта, в том числе ChatGPT, могут быть использованы злоумышленниками. Как передает Reuters, с помощью этих нейросетей может производиться фишинг, дезинформация и распространение пропаганды, а также киберпреступность. В связи с этим полицейская служба порекомендовала компаниям и госучреждениям обеспечить высокий уровень кибербезопасности и следить за возможными преступными действиями.

В России тоже столкнулись с обманом благодаря продвинутости современных нейросетей. Студент РГГУ Александр Жадан поделился в Сети алгоритмом создания своей дипломной работы с помощью чат-бота ChatGPT. На весь процесс у него ушло не более суток, а оригинальность выпускной работы составила 82%. После этого в университете предложили запретить использовать данную нейросеть в образовательных учреждениях из-за возможного влияния на обучение.

Напомним, бесплатный и доступный всем пользователям чат-бот ChatGPT представила в ноябре прошлого года компания OpenAI, одним из основателей которой был американский предприниматель, основатель Tesla и SpaceХ Илон Маск. Бот способен вести диалог и спорить, искать ошибки в коде, писать стихи и сценарии.

В марте OpenAI представила новое поколение алгоритма по обработке естественного языка – GPT-4, который интегрирован в ChatGPT. Новая модель может принимать вводные в виде текста, параллельно тестируются возможности на прием картинок. Новая версия наделена большей креативностью и более надежна в использовании.

Однако сам Илон Маск вместе с рядом других экспертов в области искусственного интеллекта (ИИ) потребовал ввести мораторий на обучение мощных нейросетей, так как неконтролируемый процесс в этой области может представлять угрозу для человечества. Об этом говорится в открытом письме экспертов в области ИИ, опубликованном на сайте некоммерческой организации Future of Life Institute («Институт будущего жизни»).

«Мы призываем все лаборатории ИИ немедленно приостановить как минимум на шесть месяцев обучение систем ИИ, более мощных, чем GPT-4. Об этом перерыве необходимо объявить публично, его исполнение должно быть проверяемым и охватывать всех ключевых участников отрасли. Если такая пауза не может быть сделана в кратчайшие сроки, то правительства должны вмешаться и ввести мораторий», – цитирует ТАСС авторов письма. О том, как новые технологии могут оказаться оружием в руках мошенников, газете ВЗГЛЯД рассказал Игорь Ашманов, ИТ-эксперт, президент компаний «Крибрум» и «Ашманов и партнеры».

ВЗГЛЯД: Игорь Станиславович, в чем заключается особенность нейросетей нового поколения?

Игорь Ашманов: Умная нейросеть – это бредогенератор нового поколения, но очень гладкий и изощренный. С одной стороны, это гигантский прорыв в технологиях генерации текстов и картинок. С другой – искусственный интеллект имеет свойство ухудшать все, до чего он дотрагивается. Он воспитывает в людях так называемую невзыскательность – привычку к низкому качеству. Например, машинный перевод, а также боты для общения с клиентами банков или мобильных операторов давно упростили работу многим организациям, поскольку им теперь не нужно нанимать огромное количество сотрудников для проделывания такой работы.

Игорь Ашманов (фото: Павел Кашаев/Global Look Press)

Однако тексты, переведенные компьютером, оказываются весьма топорными, а общение с ботом становится проблемой для клиентов. Бот по своей сути занимается лишь тем, что отгоняет клиента и экономит деньги контакт-центра, для чего старается не пропускать человека к живому оператору для решения его проблемы.

ВЗГЛЯД: Параллельно с этим высказываются опасения о том, что боты ChatGPT и GPT-4 могут создавать фейки. Так ли это?

И. А.: Такие нейросети, как ChatGPT и GPT-4, обучаются на гигантских объемах данных и уже выдают читабельные тексты, хорошие картинки, будто их создал реальный человек. В связи с этим вскоре мы столкнемся с ситуацией, когда через ChatGPT, GPT-4 будут создаваться различные фейки, фальсифицированные документы, видео и фото, которые будет очень непросто отличить от оригинала.

ВЗГЛЯД: Какие вы видите угрозы с распространением умных нейросетей?

И. А.: Я думаю, государства начнут использовать генеративные сети для пропаганды. Скорее всего, их могут начать применять и при ведении боевых действий, например, для голосового управления дронами. Кроме того, они могут использоваться мошенниками для вымогания денежных средств у обычных людей. Технологии развились настолько, что мошенники смогут автоматически генерировать готовые тексты для вымогательства личной информации у потенциальной жертвы.

ВЗГЛЯД: А какого рода информацию они могут генерировать?

И. А.: Они смогут подделать видео, на котором будет показан сгенерированный персонаж, изображающий родственника жертвы в сложной ситуации, говорящий «своим», неотличимым голосом. Дипфейки также можно использовать для репутационных атак, шантажа. Сама по себе цифровая сфера дает возможность мошенникам работать с десятками, а то и сотнями людей в день. А с помощью генерирующих нейросетей будут производиться дозвоны тысячам потенциальных жертв одновременно, с автоматическим ведением диалога «разводки» и определением того, «ведется» ли жертва. Количество жертв таких преступлений существенно возрастет.

Еще одна опасность нейросетей заключается в том, что злоумышленники могут использовать эти же технологии для подначивания граждан на саботаж или на какие-либо преступные действия во время военных действий. Например, убеждать их поджечь военкомат «коктейлем Молотова», поджечь электрошкаф на железной дороге и так далее.

ВЗГЛЯД: Как противодействовать таким угрозам?

И. А.: Меры, которые помогут частично защитить граждан от потенциальных злоумышленников, использующих нейросети, должны применяться на государственном уровне. В интернете необходимо обеспечить базовую безопасность, которой на данный момент практически нет. Можно это делать и на бытовом уровне, руками самих пользователей. Например, доверчивым пожилым родственникам необходимо ограничивать доступ в Сеть, разрешить вход только на проверенные сайты, запретить брать звонки с незнакомых номеров, тем более – иностранных.

Также необходимо ввести законодательную работу с сотовыми операторами, которые не хотят запрещать подмену телефонных номеров при звонках и блокировать номера мошенников. Для этого нужны изменения на законодательном уровне – в том числе введение уголовной ответственности за незаконный оборот персональных данных. Это, кстати, планирует сделать Госдума уже в апреле.

Тимофей Бордачёв

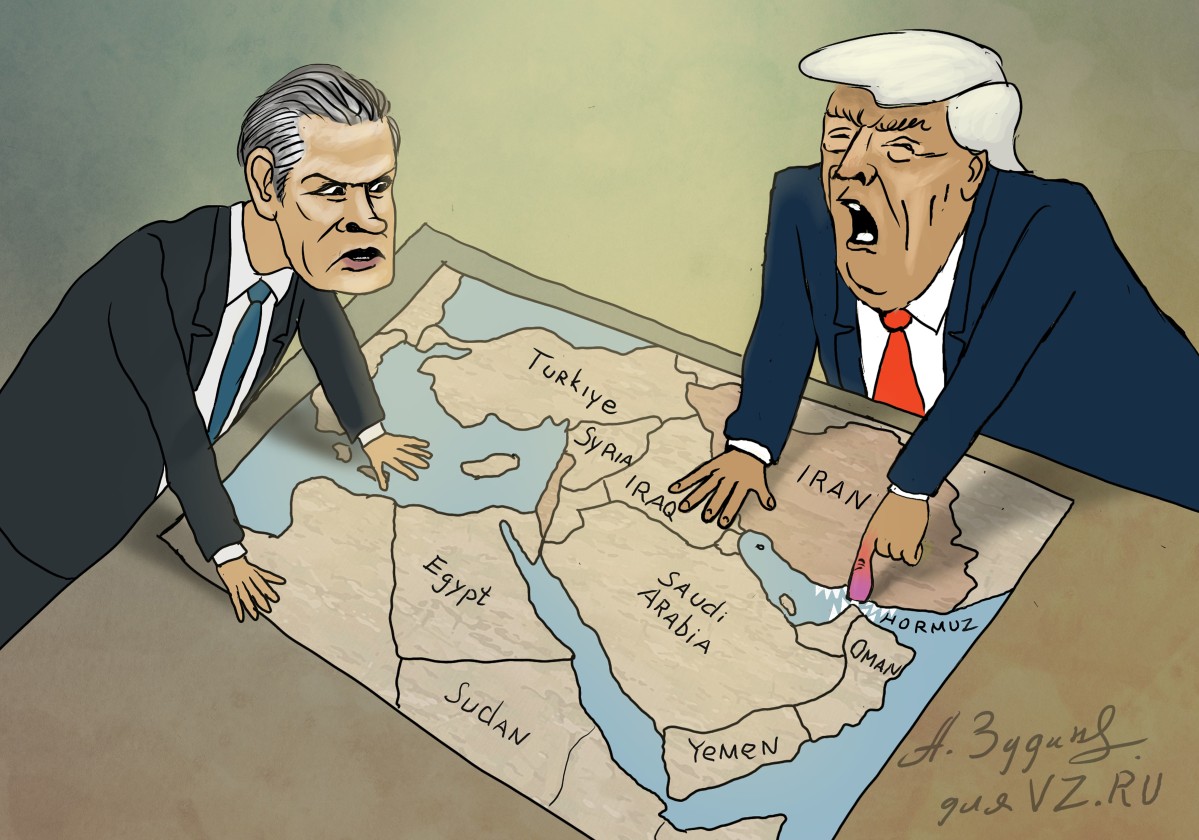

Великим державам пора экономить силы

Тимофей Бордачёв

Великим державам пора экономить силы